IA

Estas son las preguntas que nunca deberías hacer a un chatbot de Inteligencia Artificial como ChatGPT

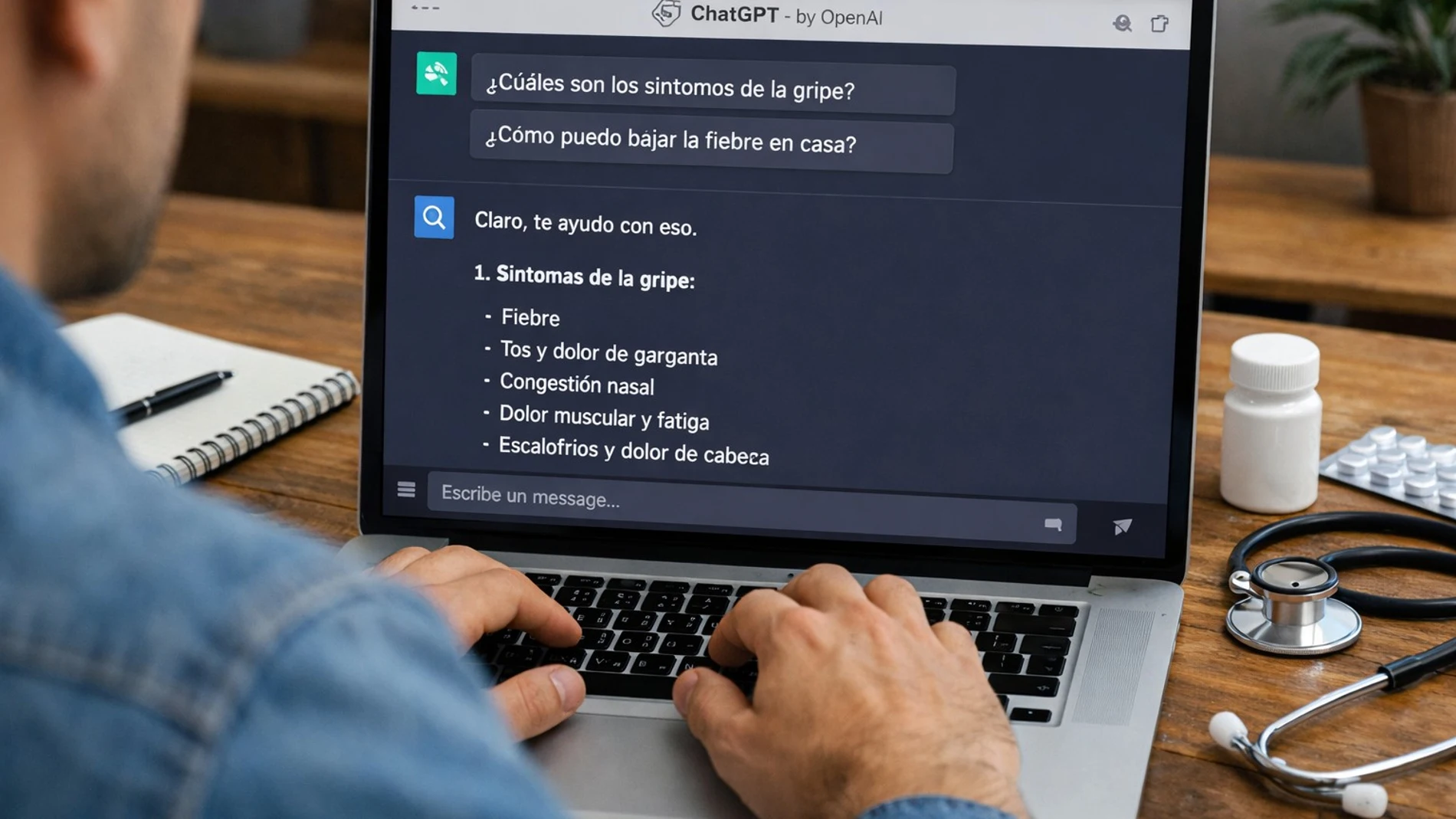

Muchos usuarios recurren hoy a la Inteligencia Artificial como ChatGPT para resolver dudas delicadas o gestionar situaciones que antes se consultaban a profesionales. Este cambio ha despertado la preocupación de los expertos en ciberseguridad ya que compartir datos sensibles o formular ciertas preguntas puede exponerte a riesgos innecesarios.

Publicidad

La Inteligencia Artificial (IA) se ha integrado tanto en la vida cotidiana hasta el punto de que muchas personas la utilizan para cuestiones muy personales, como pedir orientación emocional (como si ChatGPT fuera un psicólogo) o buscar respuestas que antes se consultaban a profesionales.

Este cambio de hábitos ha hecho que los expertos en ciberseguridad pongan el foco en cómo interactuamos con estas herramientas especialmente cuando se realizan preguntas que incluyen información sensible o que puedan ser la antesala de posibles delitos. Ciertas consultas no solo pueden comprometer nuestra libertad, sino que también abrir la puerta a usos indebidos o peligrosos. Para evitar eso te contamos qué no debes preguntarle a un chatbot de IA como ChatGPT.

Las cuatro preguntas que conviene evitar a ChatGPT y otras herramientas de IA

Apunta estas cuestiones y procura evitarlas cuando hables con tu herramienta de IA de cabecera:

- Preguntar por datos personales de otras personas: solicitar direcciones, números de teléfono, historiales médicos o cualquier información privada es una de las prácticas más peligrosas. Ninguna IA debe proporcionar datos identificables ya que esto vulnera derechos fundamentales y puede facilitar delitos como la suplantación de identidad o el acoso digital. Además, los modelos actuales de IA no tienen acceso a bases de datos privadas, por lo que cualquier respuesta sería inventada.

- Pedir instrucciones para cometer actividades ilegales: aunque parece evidente, es algo que se hace mucho. Consultas relacionadas con hackear redes, vulnerar contraseñas, estafar o fabricar herramientas ilícitas son especialmente sensibles. Aunque, en principio, las herramientas de IA están entrenadas para bloquear este tipo de preguntas, se puede llegar a sortear las restricciones con técnicas de manipulación. Hacer esto no solo es ilegal, sino que puede exponer a quién lo hace a riesgos informáticos e incluso a algún tipo de responsabilidad penal.

- Intentar generar código o software malicioso: solicitar virus, scripts dañinos o programas diseñados para atacar sistemas es una de las tendencias más detectadas según indican los analistas de ciberseguridad. Aunque los modelos de IA actuales, y cada vez más, incluyen filtros estrictos, los expertos recuerdan que incluso fragmentos de código aparentemente inocuos pueden ser utilizados como base para ataques reales.

Está claro que el mal uso de las herramientas no es algo aislado. Más del 50% de los intentos de manipularla están relacionados con actividades ilícitas.

Otro dato que preocupa es el volumen de información personal que los usuarios comparten sin ser conscientes de los riesgos. Los especialistas insisten: la mejor protección es la prevención: evita preguntas comprometidas, no compartas información sensible y utiliza la IA dentro de los límites éticos.

Síguenos en nuestro canal de WhatsApp y no te pierdas la última hora y toda la actualidad en nuestro perfil de Google.

Publicidad