Deepfake

Se da cuenta de que ha sido víctima de un 'deepfake' con un vídeo porno con su cara

La mujer descubrió al contar su historia que falsificar un vídeo se puede hacer de un forma fácil, incluso en cuestión de segundos.

Publicidad

La vida de Kate Isaacs cambió cuando entro en Twitter y vio que alguien había publicado un vídeo de ella manteniendo relaciones sexuales. Además del terror y la vulnerabilidad que sintió al verlo, también se sintió confundida porque no recordaba que ella hubiera consentido eso. Tampoco recordaba que hubiera sido grabada: "Pero eso cuando fue, con quién estoy teniendo sexo, no recuerdo, no creo que haya consentido esto", pensó cuando lo vio, según recoge 'metro.co.uk'.

Kate Isaacs siguió mirando el vídeo publicado en la red con más detenimiento y llegó a una conclusión: era su cara, pero no su cuerpo. Ella se había convertido en víctima de una pornografía falsa usando la tecnología 'deepfake'.

La víctima de este caso cree que fue atacada por el trabajo que había realizado anteriormente y con el que consiguió eliminar 10 millones de videos de pornografía infantily no consentidos en una plataforma para adultos.

Además, también publicaron las direcciones del trabajo y de la casa de Kate, quién afirma que recibió amenazas. "Me sentía tan increíblemente vulnerable y no quería salir (...) Fue una de las cosas más aterradoras por las que he pasado", declara en el medio británico.

La doble cara de la tecnología 'deepfake'

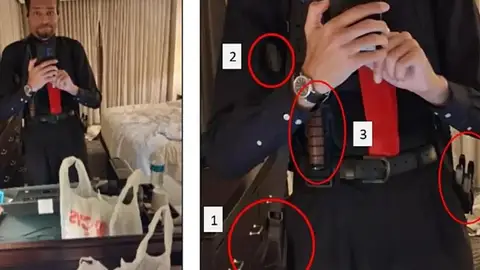

La tecnología 'deepfake' es una especie de inteligencia artificial que se puede usar en los vídeos mostrando imágenes 'fake' o falsas. Generalmente se puede usar para cambiar el rostro de una persona. Es decir, se puede poner la cara de una persona y el cuerpo de otra.

Se utiliza, por ejemplo, en SnapChat para el filtro de cambio de género o para realizar vídeos virales y divertidos. Pero no todo lo que se difunde es cierto. También se puede utilizar para crear noticias falsas, hacerse pasar por otra persona incluso para la pornografía.

Esta la tecnología avanza a un ritmo tan veloz que ahora se puede crear una imagen falsa rápidamente. Existen aplicaciones que puede usar cualquier usuario capaces de crear un video 'fake' en ocho segundos.

Más Noticias

-

Trump se someterá a un chequeo médico tras aumentar los rumores sobre su estado de salud

Trump se someterá a un chequeo médico tras aumentar los rumores sobre su estado de salud

-

Irán amenaza con enriquecer uranio al 90%, un nivel apto para fabricar armas nucleares, si EE.UU. o Israel lo atacan

Irán amenaza con enriquecer uranio al 90%, un nivel apto para fabricar armas nucleares, si EE.UU. o Israel lo atacan

-

Una mujer apuñala a su peluquero porque no le gustó cómo le cortó el flequillo: "Me lo cortó con tijeras de afeitar"

Una mujer apuñala a su peluquero porque no le gustó cómo le cortó el flequillo: "Me lo cortó con tijeras de afeitar"

Un caso reciente es el de la princesa Leonor. Tal y como verificó Antena 3 Noticias (VerificaA3N) el video difundido de la princesa Leonor bailando en Tik Tok se trataba de un montaje. Unas imágenes que parecían muy realistas, pero que sin embargo, era ficticias. Las imágenes originales pertenecen a la tiktoker filipina Ericka Pineda (@erickapineda09). La Casa Real desmintió que ese video fuera de la princesa de Asturias y aseguraron que la futura reina no tiene perfiles en redes sociales.

Publicidad